Craignez-vous que vos données confidentielles s’évaporent à cause d’un simple outil de travail mal sécurisé ? Cet article décrypte les enjeux de la intelligence artificielle sécurité pour vous aider à protéger votre organisation contre le phishing sophistiqué et les fuites de données accidentelles. Vous découvrirez des stratégies concrètes de cyberrésilience et des méthodes d’audit pour transformer ce défi technologique en un bouclier numérique infaillible.

- Pourquoi la sécurité intelligence artificielle change la donne en 2026

- 3 risques cyber que l’IA rend plus dangereux pour votre organisation

- Vulnerabilités des modèles : quand l’IA devient le maillon faible

- Stratégies concrètes pour une gouvernance IA robuste et éthique

Pourquoi la sécurité intelligence artificielle change la donne en 2026

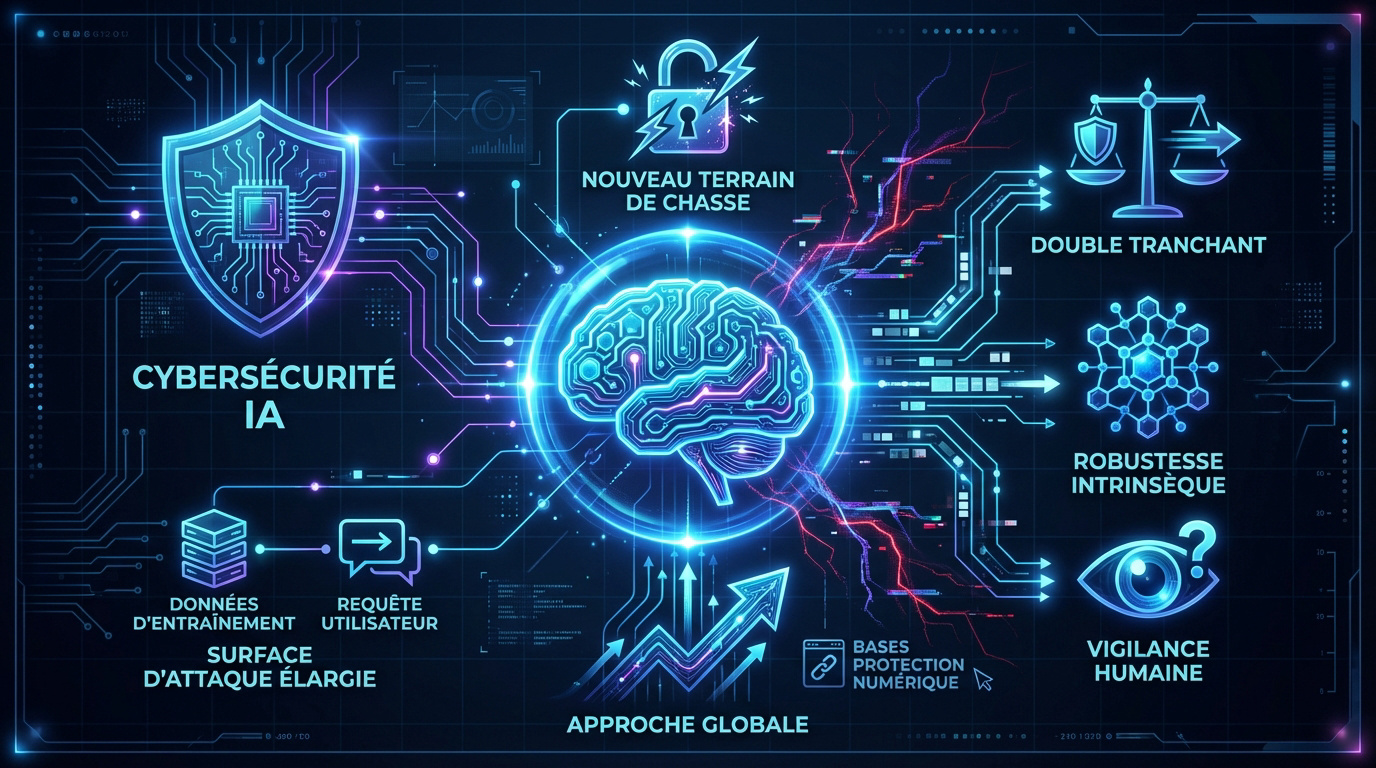

En 2026, l’IA est devenue le terrain de chasse privilégié des pirates. Cette réalité nous force à repenser nos vieux réflexes de défense pour protéger nos systèmes.

Définir la cybersécurité propre aux environnements d’IA

Protéger une IA dépasse le simple pare-feu. Il faut garantir l’intégrité des algorithmes et de la logique interne. C’est une couche de complexité supplémentaire pour vos serveurs.

Protection des algorithmes, des données d’entraînement et des requêtes contre toute manipulation malveillante.

La surface d’attaque inclut désormais les données d’entraînement et les requêtes utilisateurs. Chaque interaction devient une faille potentielle pour le système global.

Il est indispensable de maîtriser les bases de la protection numérique. Ces fondations sont le socle avant d’aborder la complexité de l’intelligence artificielle.

Les trois axes pour comprendre la cyberrésilience actuelle

L’IA est une arme à double tranchant. Elle aide à détecter les anomalies suspectes. Mais elle permet aussi aux attaquants de frapper bien plus vite.

La sécurisation doit être intrinsèque au modèle. On ne peut pas patcher un cerveau numérique comme un logiciel. La robustesse se joue dès la conception.

L’outil ne remplace pas le jugement critique de l’expert. L’humain reste le dernier rempart face aux erreurs de la machine.

La technologie et l’humain doivent marcher ensemble. Cette approche globale garantit une sécurité intelligence artificielle réellement efficace aujourd’hui.

3 risques cyber que l’IA rend plus dangereux pour votre organisation

Maintenant que le décor est planté, voyons comment ces théories se transforment en menaces bien réelles pour votre boîte.

L’ingénierie sociale et le phishing dopés aux algorithmes

L’IA crée des emails parfaits sans fautes d’orthographe. Les messages sont personnalisés via vos données publiques pour tromper vos employés. Cette précision rend l’hameçonnage redoutable au quotidien.

- Urgence inhabituelle de la demande.

- Ton trop familier ou formel.

- Liens vers des domaines modifiés.

Une bonne sécurité email phishing reste votre rempart indispensable face à ces attaques automatisées.

Deepfakes et usurpation d’identité : le défi de la confiance

La fraude au président version 2.0 utilise des appels simulés. Un clone vocal peut être généré avec une précision effrayante. La voix de votre patron n’est plus une preuve d’identité fiable.

Utilisez la vérification hors bande pour tout virement suspect. Un simple SMS ou un appel direct sur un numéro connu casse la fraude. Ne validez jamais une action sensible via un seul canal de communication.

Fuites de données confidentielles via les outils grand public

Les versions gratuites aspirent vos données pour s’entraîner. Les solutions pro offrent de réelles garanties de confidentialité.

| Critère | IA Grand Public | IA Professionnelle |

|---|---|---|

| Propriété | Fournisseur | Organisation cliente |

| Entraînement | Oui (données aspirées) | Non (données privées) |

| Auditabilité | Absente | Logs de sécurité |

| Coût | Gratuit | Abonnement sécurisé |

Un employé collant un code source confidentiel dans un chat public crée une faille majeure. L’intelligence artificielle sécurité passe avant tout par une sensibilisation humaine rigoureuse.

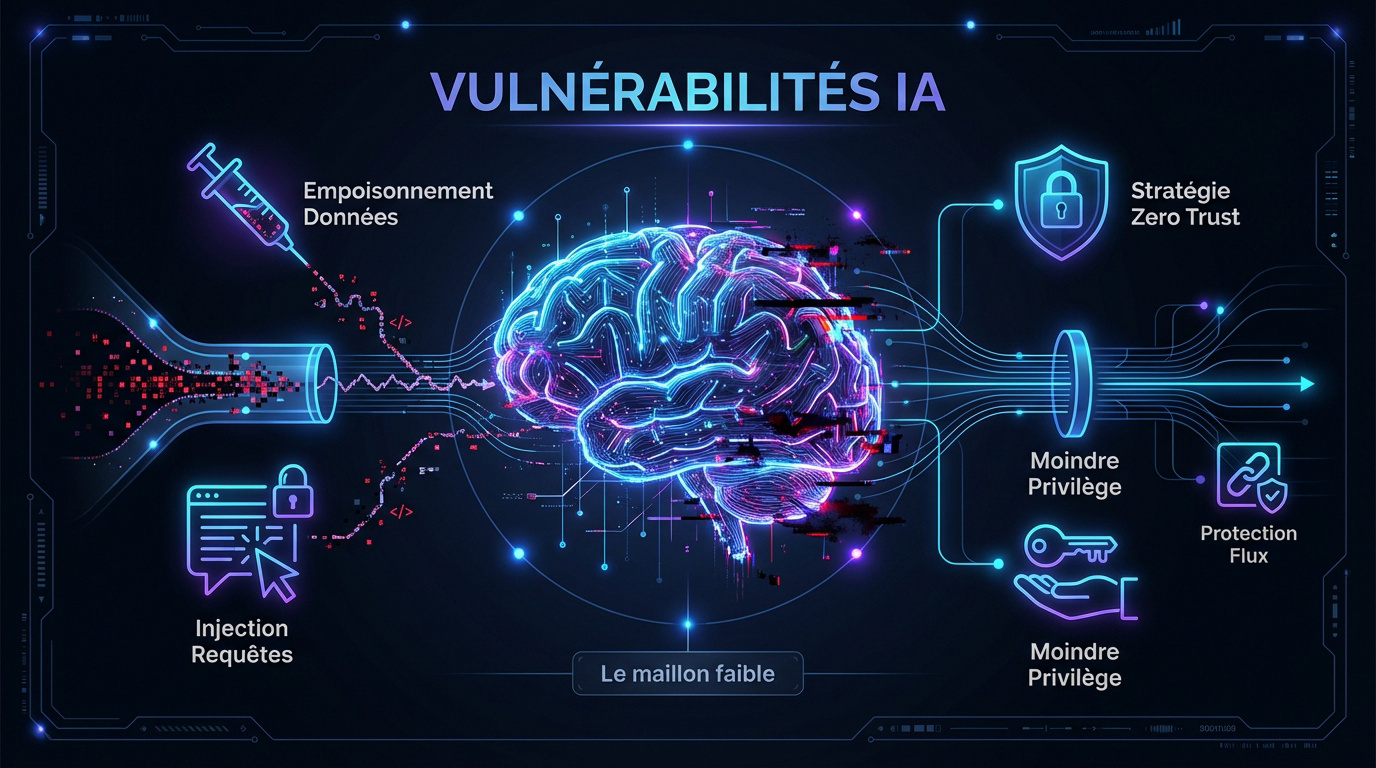

Vulnerabilités des modèles : quand l’IA devient le maillon faible

Au-delà des arnaques classiques, c’est le cœur même de la machine qui peut être corrompu par des techniques de manipulation inédites.

Empoisonnement des données et injections de requêtes

Le Data Poisoning corrompt l’apprentissage. En injectant de fausses informations, on biaise les résultats futurs. Le modèle devient alors un cheval de Troie.

L’injection de prompt manipule les instructions. L’attaquant force le LLM à ignorer ses filtres de sécurité. Il peut ainsi dérober des secrets industriels précieux.

Ces attaques restent souvent invisibles. On ne les détecte que trop tard. Le mal est alors déjà fait.

Adopter une stratégie Zero Trust pour sécuriser les LLM

Appliquez toujours le moindre privilège. Un agent IA accède uniquement aux données nécessaires. Ne lui donnez jamais les clés globales du système.

Isolez systématiquement les flux. L’utilisateur ne parle jamais au cœur sans intermédiaire. Cette barrière protège l’intégrité face aux requêtes malveillantes.

Utilisez une protection des flux de données robuste. C’est la base pour vérifier chaque accès et authentifier chaque requête d’agent.

La vigilance humaine reste indispensable. Surveillez les comportements anormaux pour garantir une intelligence artificielle sécurité totale. C’est ainsi que nous protégeons nos actifs.

Stratégies concrètes pour une gouvernance IA robuste et éthique

Pour ne pas finir dans le décor, il faut poser des rails solides : c’est tout l’enjeu de la gouvernance et de l’IA défensive.

Audits de sécurité et traçabilité des décisions algorithmiques

Mettre en place des logs détaillés est vital. Il faut pouvoir expliquer pourquoi une IA a pris telle décision. C’est indispensable pour la conformité et pour repérer une intrusion suspecte rapidement.

Réaliser des audits réguliers devient alors obligatoire. Le cycle de vie d’un projet IA impose une surveillance constante, pas seulement au lancement.

Sensibilisation des équipes et création d’une charte d’utilisation

Former les collaborateurs est votre meilleure défense. Ils doivent savoir identifier une anomalie ou un comportement bizarre de l’outil. L’éducation réduit drastiquement les risques d’erreur humaine.

- Interdiction des données sensibles.

- Outils approuvés uniquement.

- Signalement obligatoire des bugs.

Automatiser la réponse aux incidents avec l’IA défensive

Utiliser l’IA pour bloquer les robots est devenu incontournable. L’analyse comportementale repère les attaques à une vitesse surhumaine. C’est le seul moyen de contrer des menaces elles-mêmes automatisées.

L’automatisation permet de réagir instantanément face aux intrusions. Pour protéger vos systèmes, misez sur des suites de sécurité modernes intégrant l’IA capables d’isoler les menaces. Ces outils garantissent une résilience opérationnelle face aux cyberattaques.

Face à l’automatisation des menaces, sécuriser vos algorithmes et vos accès devient vital. Adoptez dès maintenant une stratégie Zero Trust et formez vos équipes pour transformer votre protection numérique en un avantage compétitif durable. Anticipez demain pour ne plus jamais subir les failles du futur.

FAQ

Quelle est la différence entre la cybersécurité classique et celle de l’IA ?

La cybersécurité traditionnelle fonctionne avec des règles fixes et des signatures pour bloquer les menaces déjà connues, comme un gardien qui vérifie une liste d’invités. C’est une approche réactive qui montre ses limites face aux nouvelles attaques invisibles ou changeantes.

La sécurité optimisée par l’IA est prédictive. Elle analyse des montagnes de données en temps réel pour repérer des comportements bizarres, même si la menace n’a jamais été vue auparavant. Elle apprend et s’adapte en continu, offrant une protection bien plus agile et autonome que les anciens systèmes statiques.

Comment l’intelligence artificielle rend-elle le phishing plus dangereux ?

L’IA permet aux pirates de créer des emails d’hameçonnage hyper-personnalisés et sans aucune faute d’orthographe, ce qui les rend terriblement crédibles. Ils utilisent des données publiques pour adapter le message à chaque cible, rendant le piège presque indétectable pour un œil non averti.

En 2026, ces attaques sont automatisées de bout en bout. On voit aussi apparaître des deepfakes vocaux et vidéo capables d’imiter la voix de votre patron pour valider des virements frauduleux. La confiance ne peut plus reposer sur un simple son de voix ou une image à l’écran.

Qu’est-ce que l’empoisonnement de données ou « Data Poisoning » ?

C’est une technique sournoise où un attaquant injecte de fausses informations directement dans les données d’entraînement d’une IA. L’objectif est de corrompre l’apprentissage du modèle pour qu’il prenne des décisions biaisées ou qu’il ignore certaines menaces à l’avenir.

Le modèle devient alors un véritable cheval de Troie au sein de votre organisation. Comme l’attaque se produit durant la phase de création, elle est souvent invisible jusqu’à ce que l’IA commette une erreur grave ou divulgue des informations confidentielles.

Pourquoi est-il risqué d’utiliser des outils d’IA grand public en entreprise ?

Le principal danger réside dans la confidentialité. Les versions gratuites des outils d’IA aspirent souvent vos saisies pour entraîner leurs futurs modèles. Si l’un de vos employés y colle un code source ou un document stratégique, ces données sortent de votre contrôle et peuvent réapparaître chez des concurrents.

À l’inverse, les solutions professionnelles offrent des garanties de chiffrement et de propriété des données. Utiliser des outils non approuvés expose l’organisation à des fuites de données massives et à une perte totale de traçabilité sur les informations sensibles.

Comment protéger mon organisation contre les cyberattaques boostées à l’IA ?

Il faut adopter une stratégie « Zero Trust » : ne faites confiance à aucun signal sans vérification, surtout pour les actions sensibles. Utilisez l’IA défensive pour surveiller les comportements suspects et automatiser la réponse aux incidents, car l’humain seul ne peut plus suivre la vitesse des robots attaquants.

La formation de vos équipes reste votre meilleur bouclier. Apprenez-leur à identifier les signes d’un deepfake et mettez en place une charte d’utilisation stricte. Enfin, privilégiez des plateformes de sécurité intégrées qui offrent une visibilité complète sur vos flux de données.