Face à l’explosion des menaces zero-day et des attaques automatisées, vos systèmes de sécurité classiques basés sur des signatures fixes sont désormais aveugles. La détection d’anomalie réseau utilise l’intelligence artificielle pour apprendre le comportement normal de vos flux et identifier immédiatement la moindre déviation suspecte. Découvrez comment cette approche comportementale permet de débusquer des intrusions invisibles et des exfiltrations de données avant qu’elles ne paralysent votre infrastructure.

- Pourquoi la détection d’anomalie réseau change de dimension en 2026

- Les visages des comportements suspects sur vos infrastructures

- De la donnée brute à l’intelligence : le cycle de vie de l’analyse

- Passer de l’alerte à l’action sans subir la fatigue opérationnelle

Pourquoi la détection d’anomalie réseau change de dimension en 2026

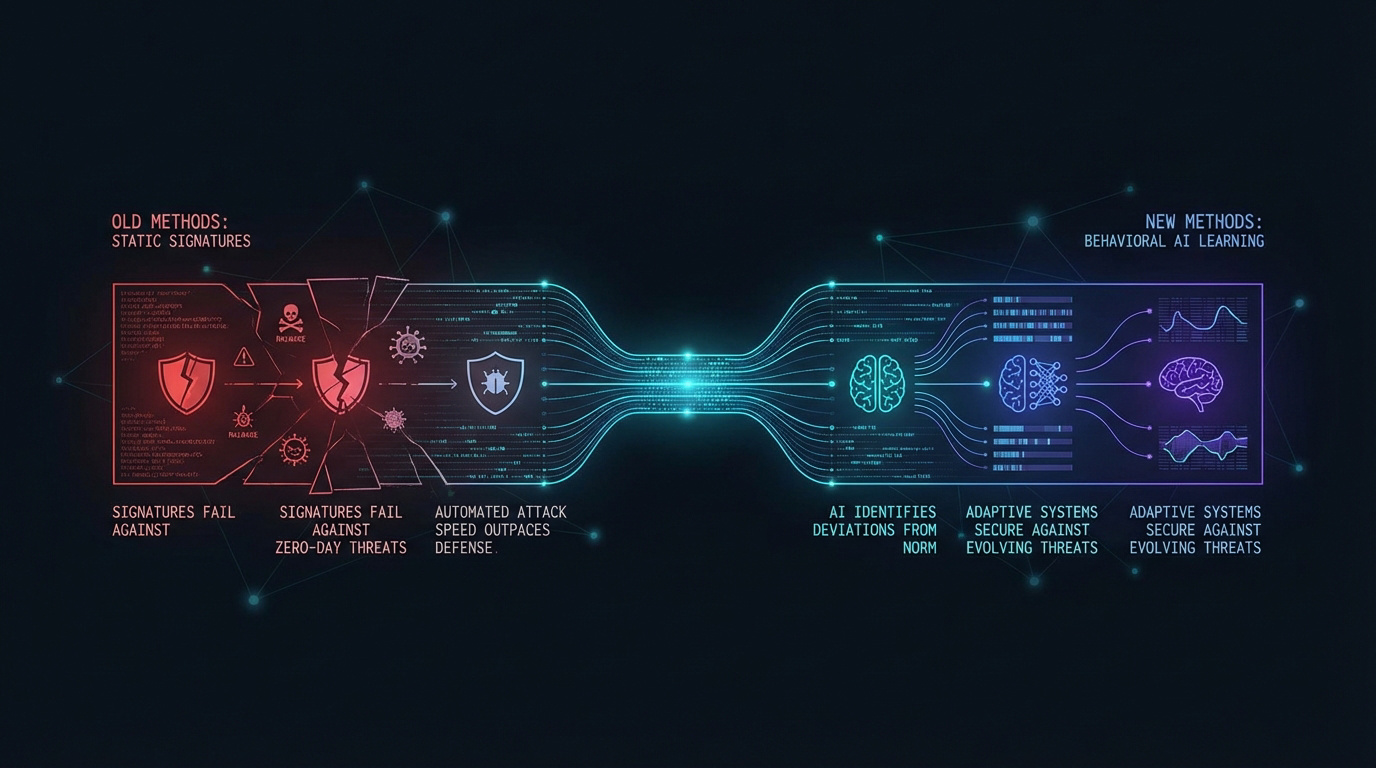

Les méthodes de défense d’hier ne suffisent plus face à l’agilité des attaquants. Un changement de paradigme est devenu vital pour protéger nos infrastructures numériques.

L’échec des systèmes à signatures face aux menaces Zero-day

Les signatures statiques montrent leurs limites. Elles ne reconnaissent que les menaces répertoriées. Face à un code inédit, ces outils restent totalement aveugles et inefficaces.

La vitesse des attaques automatisées dépasse la capacité humaine. Un analyste ne peut plus traiter des milliers d’alertes par seconde. Le décalage temporel devient critique pour la survie des données.

Il faut donc sortir du mode réactif. Anticiper l’inconnu devient la priorité absolue des équipes de sécurité actuelles.

Apprentissage comportemental pour identifier les écarts à la norme

L’IA analyse les flux pour établir un profil de vie normal. Elle repère les déviations statistiques sans règles pré-établies. C’est une approche basée sur le comportement réel des utilisateurs.

Le système apprend en continu et s’adapte aux changements. Une mise à jour légitime ne déclenchera plus d’alerte inutile. La précision s’affine avec l’usage pour débusquer des anomalies subtiles.

Ces signaux faibles cachent souvent des intrusions majeures. C’est le socle d’une défense intelligente incluant une segmentation réseau efficace. La détection anomalie réseau devient ainsi proactive et autonome.

Les visages des comportements suspects sur vos infrastructures

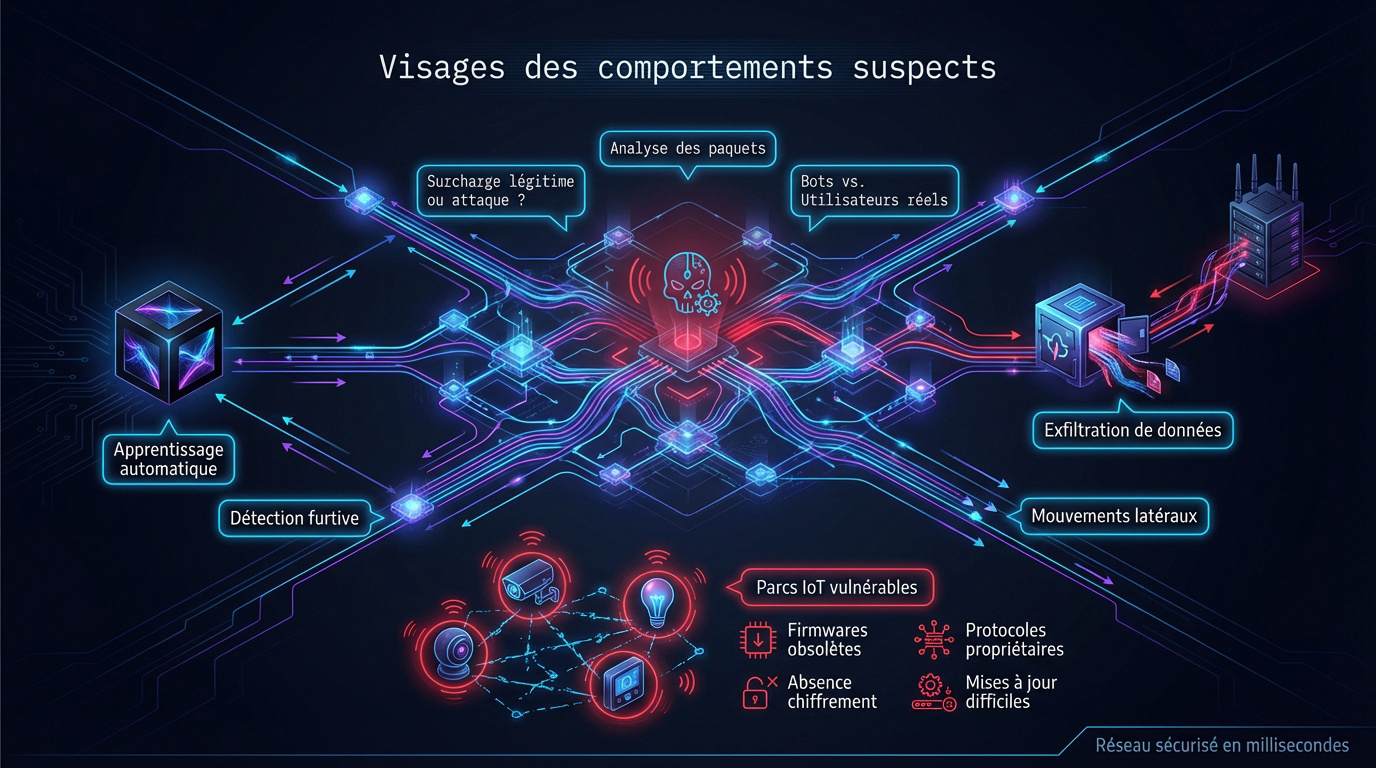

Après avoir compris l’évolution technologique, il est temps d’identifier concrètement à quoi ressemblent ces menaces dans votre trafic quotidien.

Distinguer une surcharge légitime d’une attaque DDoS furtive

Un pic de trafic peut être un simple succès commercial. Mais c’est aussi le masque parfait pour une attaque DDoS. L’analyse des paquets révèle la structure réelle du flux entrant.

L’apprentissage automatique compare ce pic aux données historiques. Il valide immédiatement si la requête provient d’utilisateurs réels ou de bots malveillants.

La décision tombe en quelques millisecondes. Le réseau reste fluide pour les vrais clients.

Exfiltration de données et mouvements latéraux invisibles

Une fois à l’intérieur, l’attaquant cherche à se déplacer discrètement. Il saute de serveur en serveur pour trouver des données sensibles. Ces mouvements latéraux sont souvent très difficiles à détecter.

Un transfert massif vers une IP externe inconnue doit alerter. C’est le signe classique d’une exfiltration de données en cours.

Surveiller ces flux internes est vital. Chaque connexion inhabituelle mérite une investigation immédiate.

Défis spécifiques à la supervision des parcs IoT

Les objets connectés sont souvent des passoires de sécurité. Leurs ressources limitées empêchent l’installation d’agents classiques. Ils deviennent alors des cibles faciles pour les botnets.

La modélisation des flux IoT permet de repérer un comportement déviant. Une caméra contactant un serveur étranger est suspecte.

Isoler ces terminaux limite les risques. La supervision doit être globale et granulaire.

- Vulnérabilité des firmwares

- Absence de chiffrement natif

- Protocoles propriétaires

- Mises à jour difficiles

La détection anomalie réseau est complexe ici à cause du manque de chiffrement, des firmwares fragiles et des protocoles fermés.

De la donnée brute à l’intelligence : le cycle de vie de l’analyse

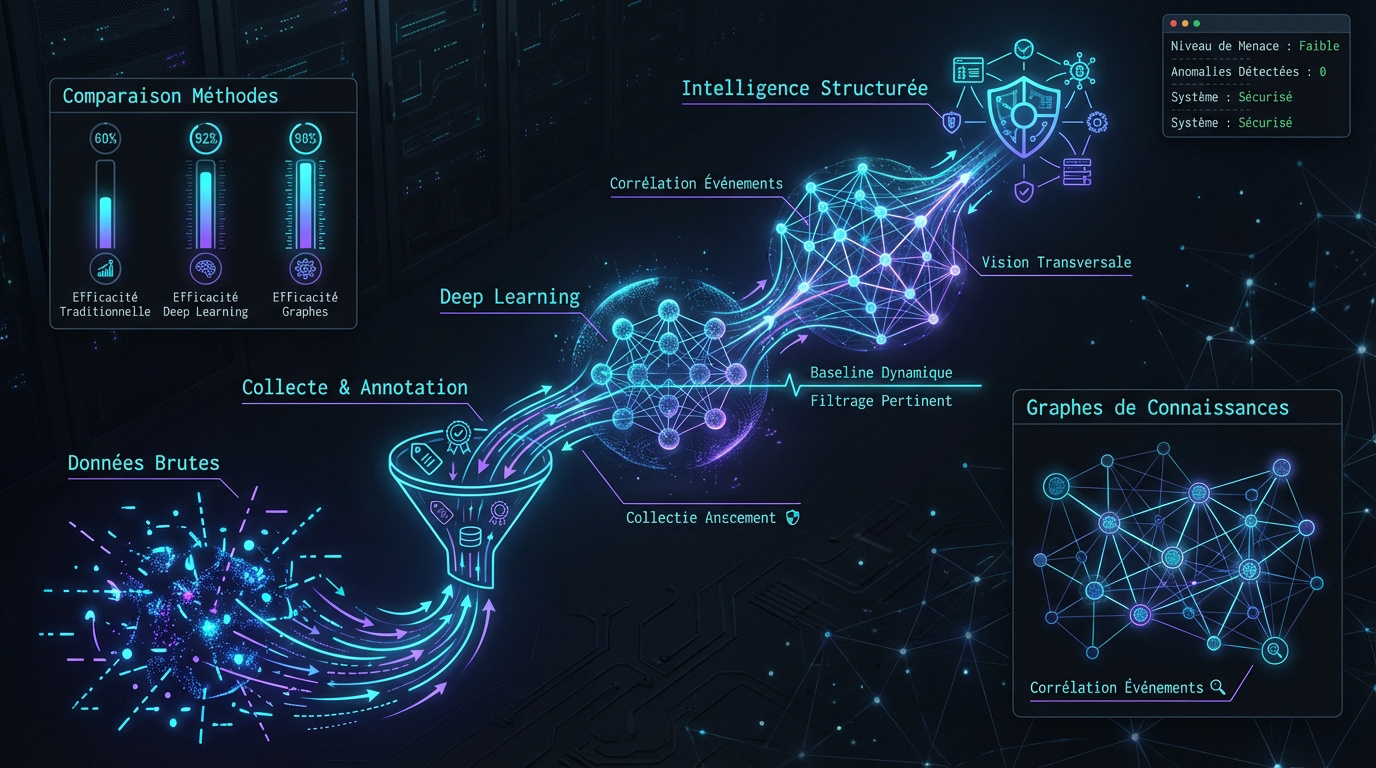

Pour que ces détections soient efficaces, il faut structurer rigoureusement le parcours de la donnée, du capteur jusqu’à l’écran de l’expert.

Collecte et annotation sans alourdir la gestion quotidienne

Collecter des logs ne doit pas paralyser vos serveurs. L’usage des standards W3C facilite l’interopérabilité. Une structuration propre dès la source gagne un temps précieux.

Il faut filtrer les informations inutiles avant le stockage. Seules les métadonnées de sécurité doivent être conservées.

L’annotation automatique enrichit les logs. Cela simplifie le travail des analystes.

Deep Learning et modèles statistiques pour fixer une baseline

Les réseaux neuronaux excellent dans la définition d’une baseline. Ils intègrent les cycles temporels d’activité. Le seuil de tolérance devient alors dynamique.

Cette précision réduit le nombre de fausses alertes. L’expert se concentre sur les incidents réels.

La machine apprend de ses erreurs. Le modèle s’affine à chaque donnée.

Graphes de connaissances pour corréler les événements multi-domaines

Une alerte isolée signifie peu. Liée à d’autres faits, elle révèle une intrusion. Les graphes reconstruisent ce puzzle invisible.

Les ontologies donnent du sens aux logs disparates. On lie enfin VPN et accès SQL.

C’est la fin du travail en silos. La vision devient transversale.

| Méthode | Principe | Avantage |

|---|---|---|

| Seuils | Règles fixes | Simplicité |

| Statistiques | Écarts types | Volumes |

| Deep Learning | Neurones | Précision |

| Graphes | Corrélations | Contexte |

Passer de l’alerte à l’action sans subir la fatigue opérationnelle

Détecter est une chose, mais la finalité reste la résolution technique rapide pour minimiser l’impact sur l’activité.

Hiérarchisation des alertes pour réduire la charge cognitive

Trop d’alertes tuent l’attention des analystes réseau. Il faut impérativement prioriser les incidents selon leur criticité réelle. Un filtrage intelligent des faux positifs préserve la lucidité des équipes techniques.

L’usage de notebooks collaboratifs facilite le partage d’investigations. Les experts peuvent documenter leurs découvertes en temps réel. Cela évite de refaire deux fois le même diagnostic complexe.

Automatisation de la réponse via les outils SOAR

Les outils SOAR exécutent des playbooks de remédiation immédiate. Ils peuvent bloquer une IP suspecte sur le firewall sans intervention humaine. Le gain de temps est tout simplement colossal.

Pourtant, gardez toujours un œil sur ces automatismes. L’équilibre entre vitesse machine et contrôle humain reste délicat. Un blocage abusif peut aussi paralyser un service légitime important.

Indicateurs clés pour mesurer l’efficacité du système

Suivez de près votre taux de détection réelle. La précision des alertes est le meilleur indicateur de santé du système. Un bon outil doit réduire le bruit de fond inutile.

Évaluez enfin le retour sur investissement technique. Une approche proactive coûte moins cher qu’une gestion de crise majeure. La sécurité est un investissement, pas une simple charge.

- Taux de faux positifs

- Temps moyen de détection (MTTD)

- Temps moyen de réponse (MTTR)

- Pourcentage d’incidents automatisés

Pour conclure sur l’aspect opérationnel, n’oubliez pas de planifier votre audit de sécurité ou un pentest pour valider vos défenses et affiner votre détection anomalie réseau.

L’IA transforme la surveillance en identifiant les menaces zero-day et les comportements suspects grâce à l’apprentissage comportemental continu. Adopter ces technologies permet d’automatiser vos réponses et de réduire la fatigue opérationnelle. Sécurisez votre infrastructure dès maintenant pour garantir une résilience durable face aux cyberattaques de demain.

FAQ

Qu’est-ce qu’une anomalie réseau et comment la détecter concrètement ?

Une anomalie réseau correspond à tout événement ou comportement qui s’écarte de la « norme » habituelle de votre infrastructure. Cela peut se manifester par des intrusions, des attaques DDoS, des malwares ou même de simples erreurs de configuration technique. Pour les repérer, on utilise aujourd’hui l’intelligence artificielle qui analyse les journaux de sécurité et le trafic en temps réel.

Le processus repose sur l’apprentissage automatique : le système étudie vos données historiques pour établir une ligne de base du comportement normal. Une fois entraîné, le modèle d’IA devient capable d’identifier des variations subtiles, comme une origine de trafic inattendue, offrant ainsi une réactivité bien supérieure aux méthodes manuelles.

Pourquoi l’IA est-elle plus efficace que les méthodes de sécurité classiques ?

Contrairement aux systèmes traditionnels basés sur des règles statiques et des signatures figées, l’IA possède une grande capacité d’adaptation. Elle ne se contente pas de chercher des menaces déjà répertoriées, mais comprend le contexte et les interdépendances entre les données. Cela lui permet de débusquer des attaques inédites, dites « Zero-day », devant lesquelles les outils classiques restent aveugles.

L’autre avantage majeur est la réduction de la fatigue opérationnelle. En analysant intelligemment les relations entre les données, l’IA filtre les changements légitimes et diminue drastiquement le taux de faux positifs. Vos équipes peuvent ainsi se concentrer sur les incidents réellement critiques plutôt que de traiter des milliers d’alertes sans importance.

Comment l’analyse comportementale permet-elle de bloquer les attaques DDoS ?

La détection comportementale ne cherche pas une « signature » de virus, mais surveille les écarts par rapport au trafic habituel. Elle repère immédiatement des anomalies comme des pics de requêtes soudains, des tailles de paquets anormales ou des connexions provenant de sources inhabituelles. C’est une protection proactive qui distingue un succès commercial légitime d’une attaque malveillante.

Cette approche est particulièrement efficace contre les attaques sophistiquées qui imitent le comportement humain pour contourner les pare-feux. En utilisant des algorithmes de clustering, le système valide en quelques millisecondes si le flux est sain, garantissant que votre réseau reste fluide pour vos vrais utilisateurs tout en bloquant les bots.

C’est quoi un mouvement latéral et comment le repérer sur son réseau ?

Un mouvement latéral est une technique utilisée par un attaquant déjà infiltré pour se déplacer d’un serveur à un autre. Son but est d’escalader ses privilèges pour atteindre des données sensibles ou prendre le contrôle de l’administration. Ces déplacements sont souvent invisibles pour les outils de surveillance classiques car ils utilisent des accès qui semblent légitimes.

Pour les détecter, il faut surveiller les connexions inhabituelles et les tâches administratives anormales. Des outils spécifiques analysent désormais le trafic d’authentification pour identifier des schémas suspects, comme un utilisateur qui accède soudainement à des bases de données SQL ou des partages de fichiers dont il n’a normalement pas l’utilité.

Pourquoi la surveillance des objets connectés (IoT) est-elle devenue prioritaire ?

Les parcs IoT représentent souvent le maillon faible de la sécurité car ces objets ont des ressources limitées pour embarquer des protections natives. Ils possèdent fréquemment des vulnérabilités de firmware ou une absence de chiffrement, ce qui en fait des cibles idéales pour créer des botnets. Une caméra ou un capteur compromis peut alors servir de porte d’entrée vers le reste de votre réseau.

La détection d’anomalies par IA permet de modéliser le flux normal de chaque objet. Si une caméra connectée commence soudainement à contacter un serveur étranger ou à scanner d’autres ports sur le réseau, le système donne l’alerte immédiatement. Isoler ces terminaux et surveiller leur comportement est essentiel pour maintenir l’intégrité de votre infrastructure globale.